INDIGO TALK / 一个 Agent 可能比十个更好用 - EP43

这期 Indigo Talk 邀请了来自 UBC Trusted and Efficient AI(TEA)Lab 的李霄霄教授在温哥华面对面深聊。霄霄的研究背景横跨耶鲁、普林斯顿、UBC 和 Vector Institute,他从神经科学转向 AI 系统研究的经历,恰好让他拥有了一个独特的双重视角:用人类认知的局限去理解 AI 的瓶颈,再用解决人类局限的方法去提升 AI 的能力。

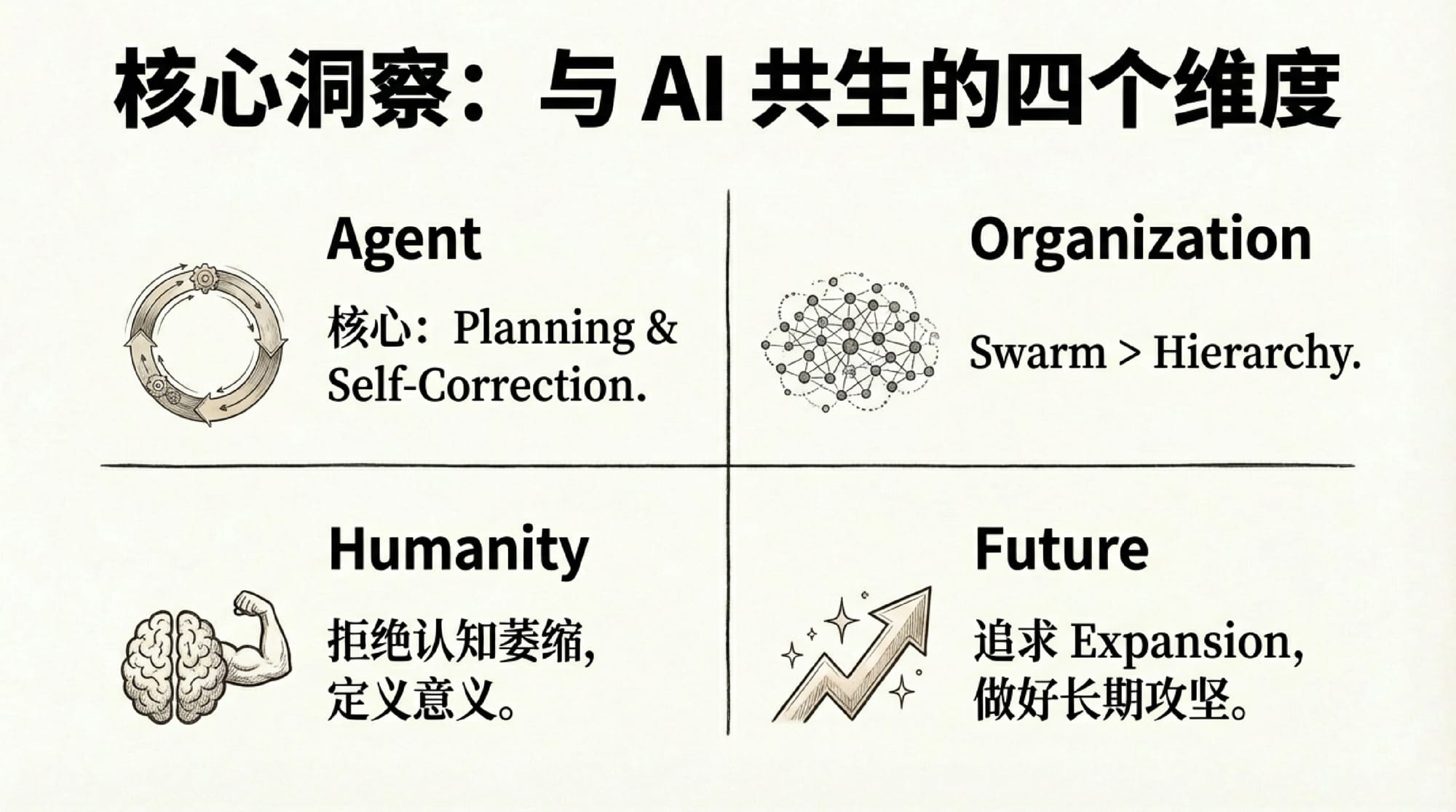

这场对话涵盖了 Agent 的定义与演进、单智能体与多智能体的效率之争、AI 安全与失败容忍、认知萎缩的隐忧,以及教育在 AI 时代的根本转型——信息密度极高,欢迎收听。

Apple Podcast & Spotify 播客| 小宇宙播客

嘉宾

李霄霄(UBC 教授 / TAE Lab 负责人)

Indigo(数字镜像博主 / 独立投资人)

时间戳

- 00:01:34 从耶鲁到 UBC:一位 AI 研究者的 12 年

- 00:08:25 Agent 到底是什么:从 1995 年教科书到 Anthropic 的定义

- 00:15:00 人类认知的局限与 AI 的平行困境

- 00:23:00 硅基 vs 碳基:两种智能的根本差异

- 00:26:00 单 Agent 加技能 vs 多 Agent 协作:效率之争

- 00:34:00 AI 的组织形态:不必模仿人类

- 00:46:00 AI 失败容忍与安全设计

- 00:53:00 外骨骼隐喻:当 AI 让大脑「萎缩」

- 01:02:00 提效 vs 拓界:AI 革命的两个维度

- 01:10:11 90-90 法则的警醒

当我们把 Agent 挂在嘴边的时候,有没有想过这个概念其实早在 1995 年的教科书里就被定义过了?当我们急于让 AI 掌握更多技能时,有没有意识到人类大脑在面对过多选项时会瞬间崩溃——而 AI 可能也逃不过类似的命运?

01

从耶鲁到 UBC:一位 AI 研究者的 12 年

加拿大在这一轮 AI 革命中的学术贡献被严重低估,从 Hinton 到 Sutton,从深度学习到强化学习,研究的火种很多都点燃在加拿大的大学里。

霄霄教授的学术轨迹颇具代表性。他在耶鲁大学的博士研究聚焦于神经科学、神经影像与人工智能的交叉领域,2020年毕业后前往普林斯顿大学做博士后,研究方向转向机器学习系统、分布式运算以及 AI 的安全与隐私问题。2021年,他加入 UBC(英属哥伦比亚大学),领导 Trusted and Efficient AI Lab——简称 TEA Lab。去年他评上了副教授,同时也在 Geoffrey Hinton 创办的 Vector Institute 担任研究员,学术休假期间还在谷歌做访问研究员。算下来,他做 AI 研究已经整整 12 年了。

TEA Lab 的名字就透露了它的核心使命:不管底层 AI 技术如何迭代,提高 AI 的可靠性和效率永远是一个值得深耕的课题。在 Pre-GPT 时代,团队关注的是卷积神经网络在图像分类、语言翻译等任务中的效率和安全性问题;到了大模型时代,这些问题非但没有消失,反而变得更加紧迫和复杂。

Indigo 特别提到了一个经常被忽视的事实:这一轮 AI 爆发的学术根基在很大程度上来自加拿大。多伦多大学的 Hinton 教授是深度学习之父,阿尔伯塔大学有写出 The Bitter Lesson 的 Richard S. Sutton,他也在与 Google 的 Gemini 团队紧密合作,蒙特利尔的 McGill 大学也贡献了大量 AI 人才。正如 Indigo 所说——加拿大负责做研究,美国负责创业赚钱。霄霄教授笑着回应,UBC 这边的 AI 研究者确实比较年轻,但假以时日,希望也能涌现出几位大佬。

02

Agent 到底是什么:从 1995 年教科书到 Anthropic 的定义

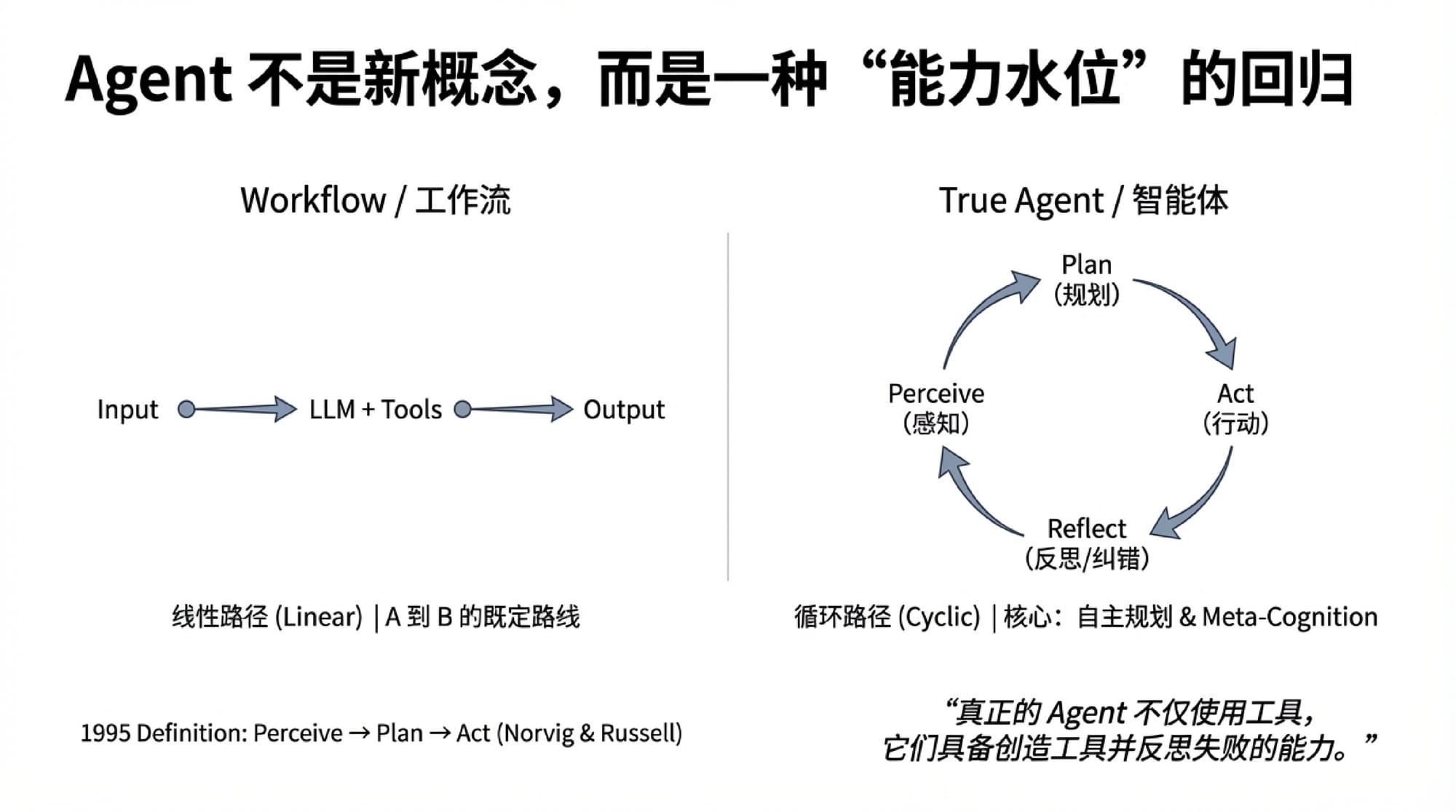

Agent 并不是一个新概念,它的学术定义早在30年前就已经明确;真正区分 Chatbot、Workflow 和 Agent 的核心,在于自主规划(Planning)能力。

2025 年,Agent 成了科技圈最火的词。从 Manus 到各种开源产品,似乎一夜之间所有的 AI 应用都贴上了 Agent 的标签。但霄霄教授提醒我们,从学术角度来看,Agent 早就不是什么新概念了。

他引用了 Peter Norvig 和 Stuart Russell 在 1995 年出版的经典教科书《Artificial Intelligence: A Modern Approach》中的定义:Agent 是一个可以感知环境、根据环境自主决策、以最大化目标的系统。这个定义与后来 Richard Sutton 在 Alberta Plan 中提到的「感知环境、自我进化」一脉相承。在大模型出现之前,这就是学术界公认的 Agent 定义。

不过,目前市场上对 Agent 的理解要宽泛得多。一些简单的对话链路或者工作流(Workflow),也被贴上了 Agent 的标签。霄霄教授引用了 Anthropic 对 Workflow 和 Agent 的一个非常清晰的区分:Workflow 是大模型和工具在既定路线下进行交互的系统;而 Agent 则具备自主 Planning 和进化的能力,不仅能使用工具,甚至能创造工具。

这个区分至关重要。Indigo 从个人使用体验出发,直言在 Planning 能力方面,Anthropic 的 Claude 是他用过的最好的。Claude 不只是能理解你在说什么,还能抓住你的想法,做出合适的计划,高效地执行,遇到问题还会自我反省、退回来修改计划。用 Indigo 的话说,它已经有了「一点点元认知能力」——知道自己在干什么。霄霄教授也观察到了同样的现象,他分析这可能是因为 Anthropic 从一开始就在做 Agent 的基础建设。当然,其他模型也有各自的长处:Gemini 速度极快,OpenAI 的 Codex 写代码能力提升显著,国内的千问、Kimi、MiniMax 等也都在快速追赶。

但核心问题始终不变:真正让 Agent 成为 Agent 的,是自主规划能力——能够根据用户的目标,自主地拆解任务、分配资源、执行并自我纠正。

03

人类认知的局限与 AI 的平行困境

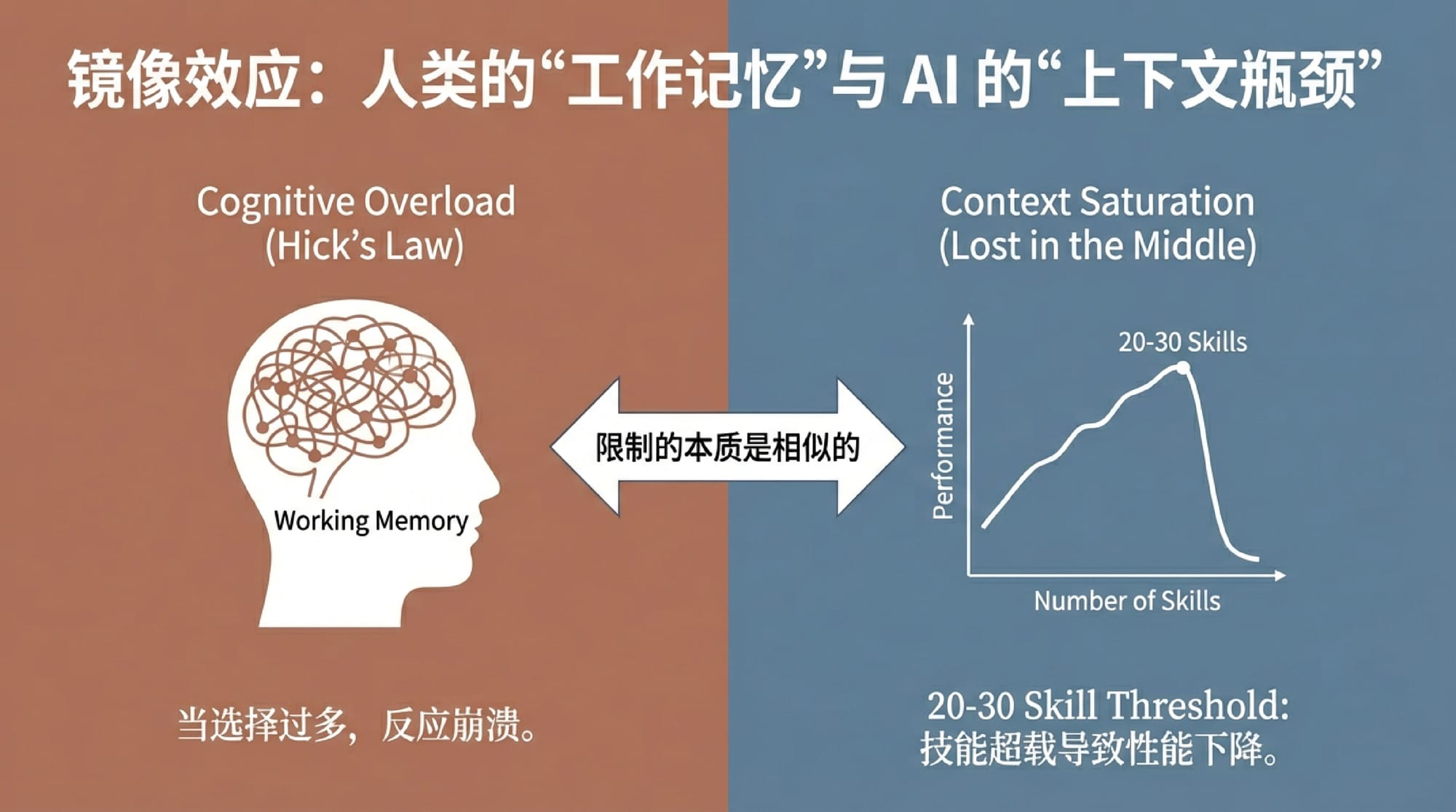

人类认知有明确的局限——工作记忆容量有限、注意力有限、技能容量有限;而 AI 虽然在很多方面比人类强大,却也展现出类似的瓶颈。通过研究人类认知局限的解决方案,可以反过来提升 AI 的能力。

这是整场对话中最令人意外的一段。霄霄教授从认知心理学出发,提出了一个深刻的类比框架:人类认知的局限,或许可以帮助我们理解 AI 为什么也会「犯傻」。

他提到了一个经典的认知科学理论——人类的认知能力是有限的。对于自然界中的复杂系统来说,人类大脑所具备的理性能力,远远不足以解决那些需要穷举所有可能性的问题。最直观的例子就是下国际象棋:理论上存在一个最优解,但人类大概只能往前看3到5步,而无法计算每一步的最终胜率。

更有趣的是 Hick's Law 实验。研究者给受试者一个灯阵列,让他们在灯亮的时候按对应的按钮。当灯的数量越来越多时,人的反应时间急剧增长,准确率也大幅下降。这揭示了人类大脑一个核心的物理限制:工作记忆(Working Memory)的容量是有限的,当任务超过这个容量时,整个认知系统就会瞬间崩溃。

那 AI 呢?Indigo 的直觉反应是:AI 不会有这个问题啊,加算力就好了,开 1000 个实例同时干活。霄霄教授对此给出了一个 Yes and No 的回答。他的研究发现,当你给一个 AI Agent 配备越来越多的 Skill 时,它的表现并不会无限提升——大概在 20 到 30 个 Skill 的时候,它能达到最佳性能;再往上加,性能就会饱和,甚至下降。

这个发现意味着,AI 虽然在很多维度上超越了人类的认知限制(比如 Transformer 的多头注意力机制可以同时关注所有信息),但它也有自己的物理瓶颈——上下文窗口就是它的「工作记忆」,当 Context 变得非常长的时候,AI 也会 Lost in the Middle。

Indigo 在这里做了一个精彩的类比:人类大脑的注意力是有限的,一次只能关注几件事;Transformer 虽然用多头注意力同时关注所有事情,但上下文就是它的物理限制——就像内存永远有物理上限一样。

04

硅基 vs 碳基:两种智能的根本差异

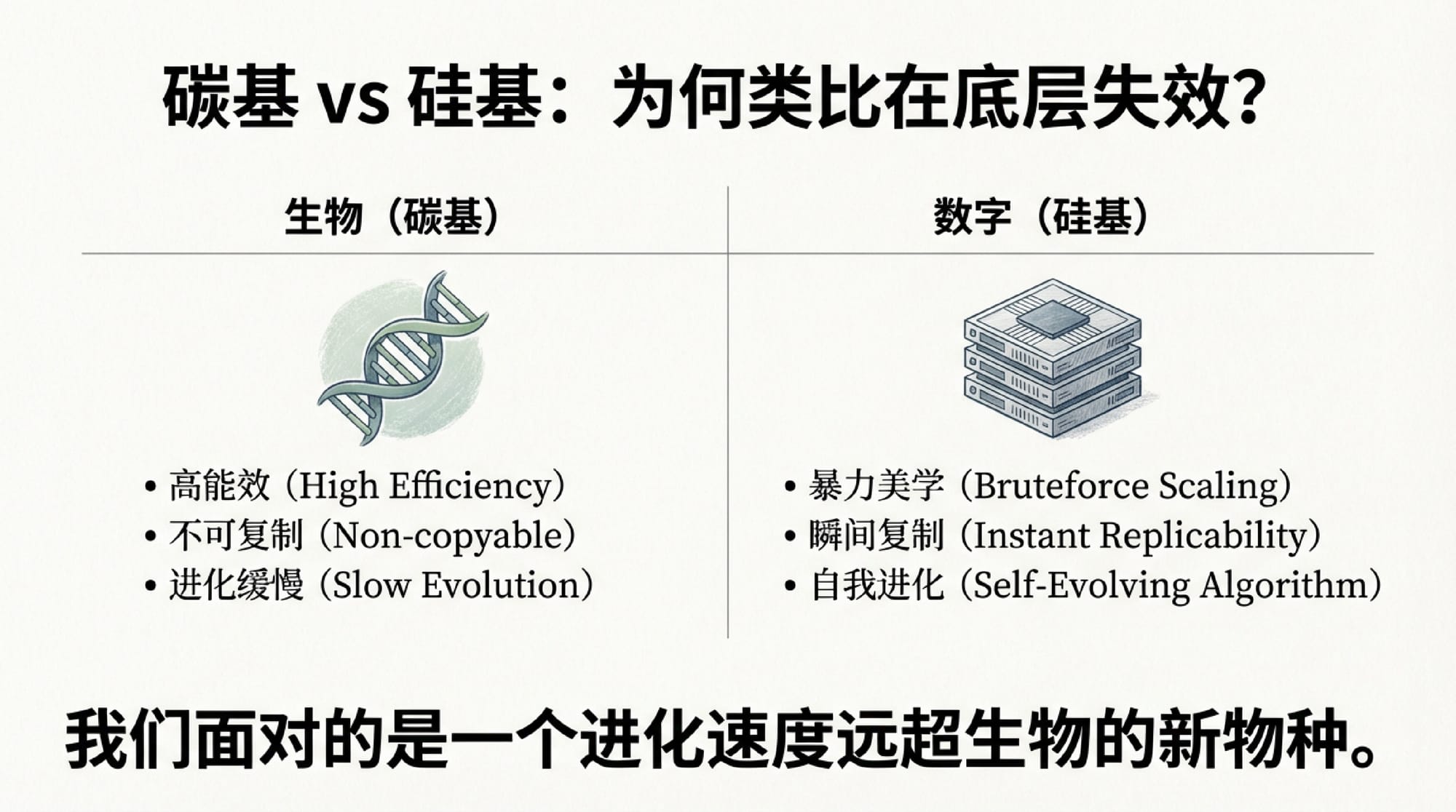

虽然我们习惯用人类认知来类比 AI,但硅基智能和碳基智能在底层原理上完全不同——AI 可以被设计、可以快速复制、可以通过暴力堆叠算力突破单体限制。

霄霄教授在这里做了一个重要的纠偏。虽然用人类认知来理解 AI 是一种有用的研究方法,但他强调不能把这种类比推到极端——硅基智能和碳基智能的底层原理就是不同的。

人类大脑使用神经电信号传递信息,经过数百万年的自然选择进化而来;AI 的核心是 Transformer 架构下的生成网络,用数学运算模拟智能。人类大脑在能量效率上远超 AI——看两个例子就能理解一个概念,而 AI 需要海量数据训练。人类的泛化学习能力也更强,这种「潜移默化」的学习方式是 AI 目前还在追赶的。

但硅基智能有一些碳基智能完全不具备的优势。第一,它可以被设计——人类可以主动给 AI 附加外界能力,把它打造成一个极其强大的系统,而人类目前无法被这样设计。第二,它可以快速复制——只要有足够的算力和能源,你可以瞬间生产出成千上万个完全相同的智能体。第三,它可以自我进化——Self-Evolving 算法让 AI 有了自主迭代的能力。

Indigo 做了一个生动的总结:在地球上,一个新的智慧物种已经诞生了,它进化的速度远超碳基生物。虽然单体能量效率不如人脑,但硅基智能可以无限「插电」,通过暴力堆叠算力和快速复制,产生完全不同形式的智能。这个事实虽然听起来有点让人不安,但确实是我们必须面对的新现实。

05

单 Agent 加技能 vs 多 Agent 协作:效率之争

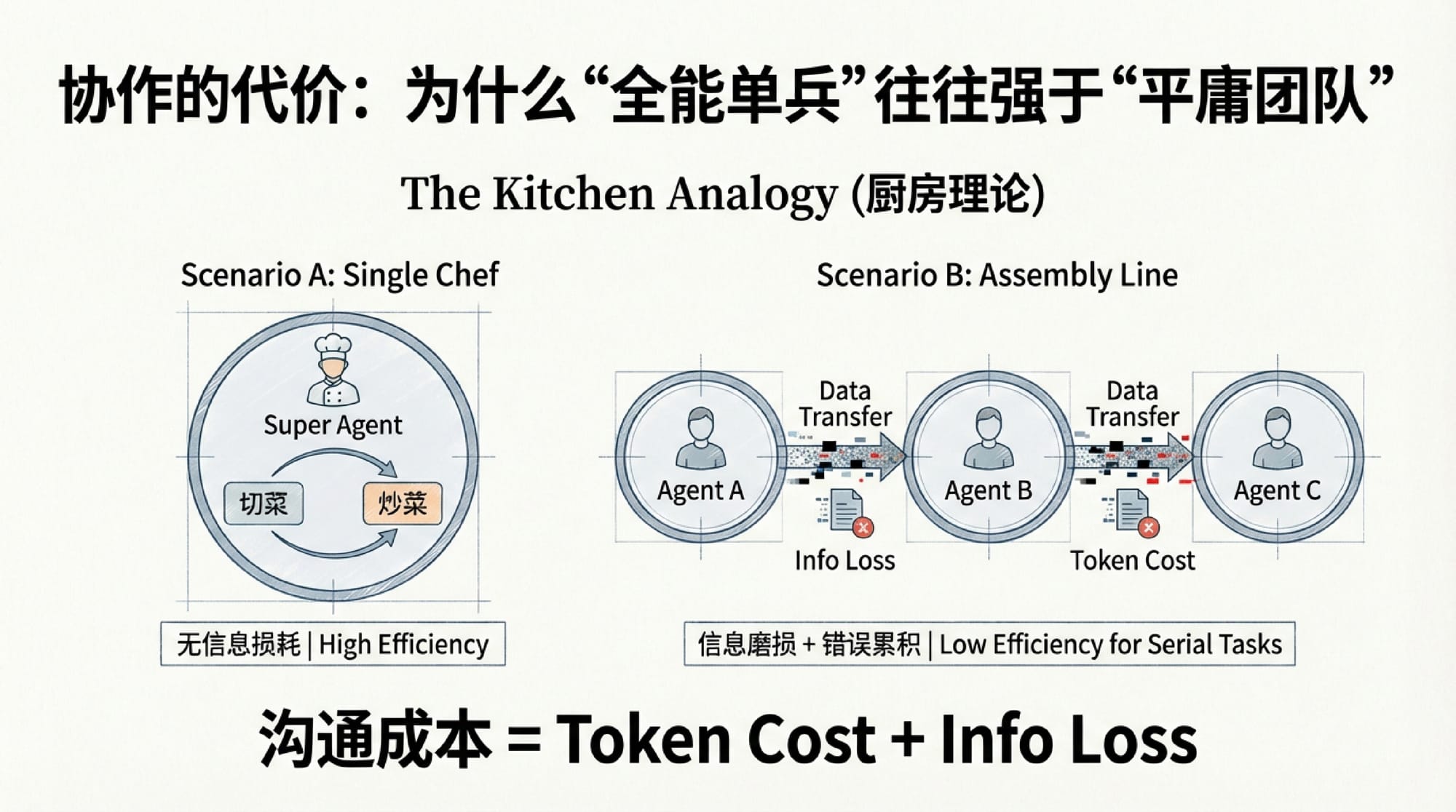

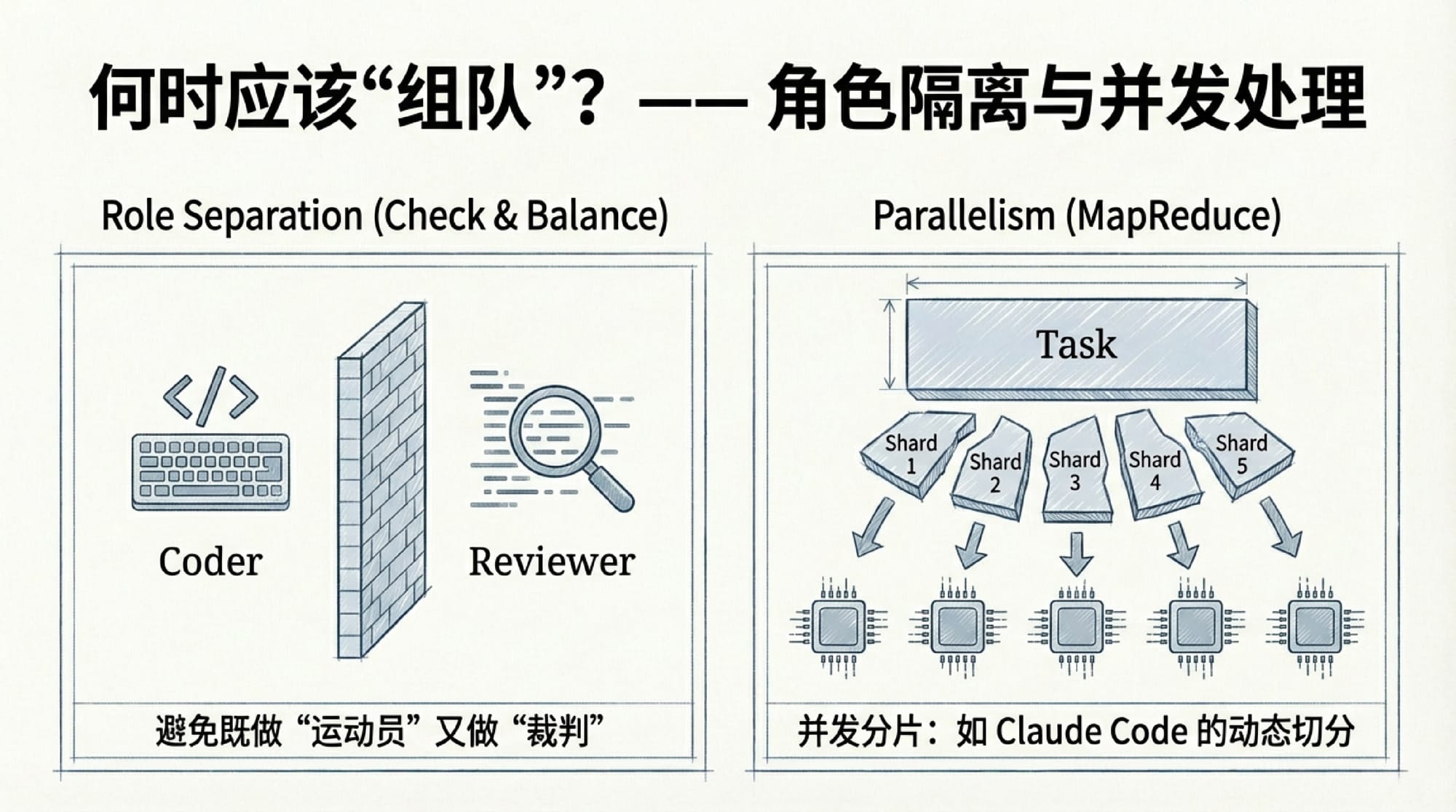

在串行任务中,单个 Agent 加上适当的 Skill 往往比多 Agent 协作更高效,因为沟通成本和错误累积是多 Agent 系统的主要瓶颈;但复杂任务中的角色分离和并行处理仍然需要多 Agent 架构。

这是霄霄教授近期最引人注目的一项研究「When Single-Agent with Skills Replace Multi-Agent Systems and When They Fail」。他的团队发现,在特定类型的任务中——尤其是那些可以串行处理的任务——给一个 Agent 赋予多种技能,往往比让多个 Agent 协作更快、更好。

为什么?原因其实和人类组织面临的问题如出一辙。当你和其他人合作完成一件事时,沟通本身就会产生信息损失。如果一个人在自己的能力范围内就能完成这件事,省去沟通环节反而效率更高。霄霄教授用做菜来打比方:如果一个人既会切菜又会炒菜,那他一个人做一道菜可能比两个人流水线配合更快,因为单人操作时上下文是连续的,他可以灵活优化自己的工作流。

多 Agent 协作还有两个额外的代价。第一是 Token 成本——Agent 之间的每一次沟通都需要消耗算力和 Token。第二是错误累积——在串联的架构中,只要有一个 Agent 出错,这个错误就会传导到所有下游的 Agent 上面去。

但这并不意味着多 Agent 架构没有价值。霄霄教授严谨地指出,他的研究聚焦的是特定类型的串行任务,并不覆盖所有场景。在两种情况下,多 Agent 协作仍然是必要的。

第一种是任务本身需要角色分离。比如 Anthropic 最近发布的 Agent Team 演示中,16个 Agent 分工合作完成了一个 C 编译器,并用它重新编译了 Linux 内核。在这种复杂的软件工程任务中,写代码的人和审核代码的人必须是分开的——就像一个人不能既当裁判又当选手。因为单个 Agent 的记忆空间无法隔离,它无法在同一个上下文中既是生产者又是审核者。

第二种是任务可以被有效地并行分片。Indigo 分享了自己使用 Claude Code 的经验:当他给 AI 下达一个编码转码任务时,AI 会自己判断是否要启动 Sub Agent,把任务分成五片让五个 Agent 同时处理。更聪明的是,AI 会动态决定什么时候分包、什么时候自己做——就像一个出色的人类调度指挥。

06

AI 的组织形态:不必模仿人类

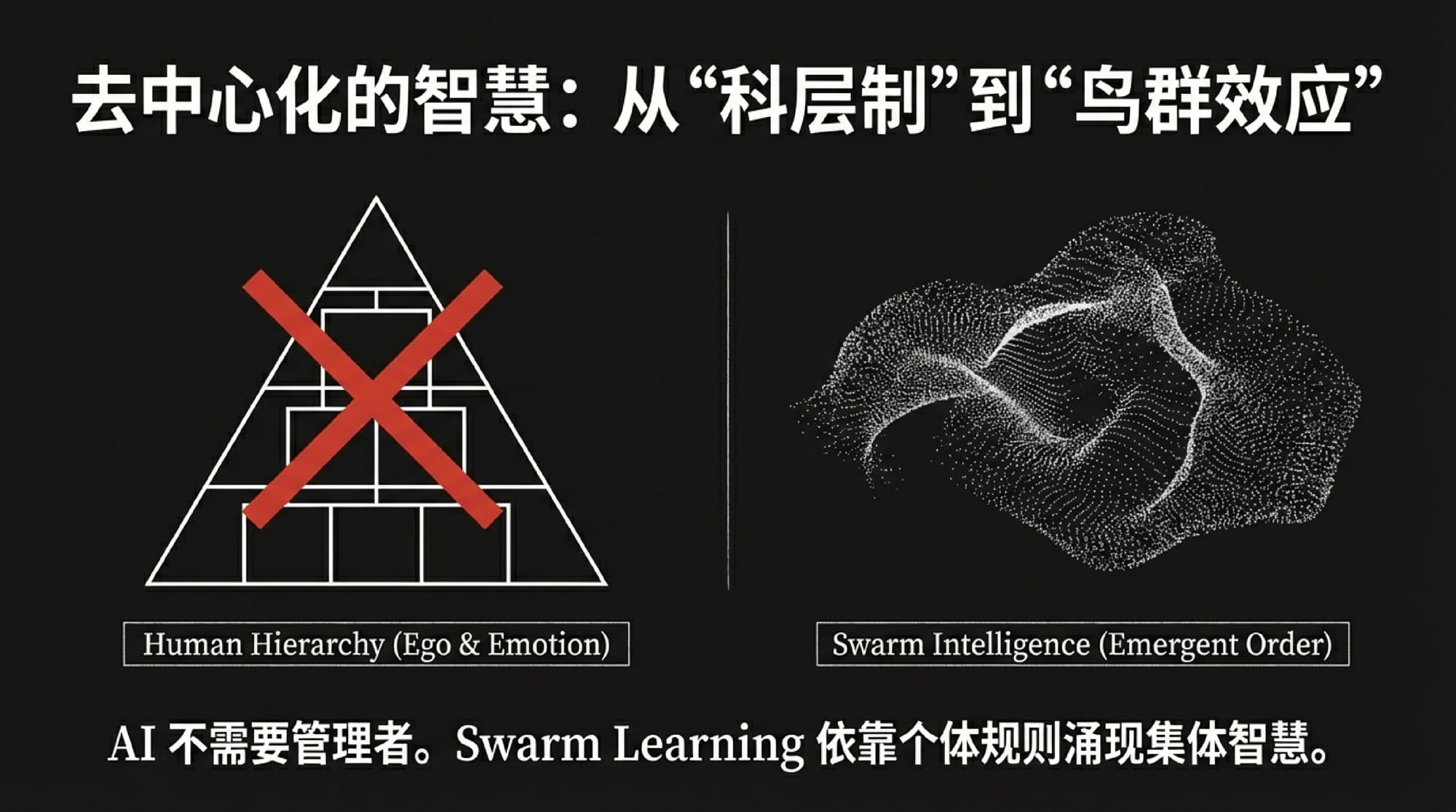

当前的多 Agent 架构过度模仿了人类的组织层级,但 AI 可能会发展出完全不同的协作模式——像鸟群或蚁群那样,无需 Leader 也能高效运作。

这段讨论特别有启发性。Indigo 首先抛出了一个观察:人类组织是一个极度冗余和低效的系统,因为人要休息、有情绪、有自尊心(EGO),这些都会在组织协作中产生巨大的摩擦。所以人类社会发展出了高层、中层、执行层这样的分层管理结构。

但对 AI 来说,这套逻辑可能完全不适用。霄霄教授提出了一个更具前瞻性的视角:他对当前 AI Agent 过度模仿人类组织架构持保留态度。AI 的思考路径可能和人类完全不同,它的组织方式也未必需要照搬人类的层级分工。

他提出了一个特别有画面感的替代模型:Swarm Learning——就像鸟群飞行一样。鸟群没有 Leader,单只鸟的智能也非常有限,但一群鸟在一起飞的时候,却能形成极其高效的组织形态。蚂蚁也是如此:单个蚂蚁很傻,也没有指挥官,但蚁群通过简单的职能分工(搬食物、喂养蚁后、守卫)和某种涌现的默契,就能表现出惊人的集体智能。

也许未来的多 Agent 系统不需要一个中央调度员,而是通过某种去中心化的协作机制,各个 Agent 自发地形成高效的组织。更有意思的是,霄霄教授认为这种 AI 原生的组织方式反过来可能启发人类——我们或许可以从 AI 的组织架构中学到如何让人类团队更高效。

07

AI 失败容忍与安全设计

不同场景对 AI 错误的容忍度天差地别,医疗和法律需要极高的准确性,而 AI 的输出设计——尤其是 Confidence Score 和高亮提示机制——可以成为安全保障的关键手段。

Indigo 和霄霄教授深入讨论了一个现实问题:我们应该在多大程度上信任 AI 的输出?

霄霄教授提到了医疗领域的一个设计思路,非常值得其他行业借鉴。在将 AI 应用于医疗辅助诊断时,系统会自动高亮那些 AI 有可能答错的关键词,把它们链接到相关的医学文献和 Clinical Guideline,强制要求医生在核实之后才能进入下一步分析。这不是简单地告诉用户「AI 可能会出错」,而是在产品设计层面嵌入了一套验证机制。

核心概念是 Confidence Score(置信度评分)。AI 本质上是概率模型,它的每一个输出都有一个对应的置信度。如果某个词或判断的置信度只有0.2(满分1.0),那它就应该被高亮出来,提醒用户需要人工审查。这种「AI 输出设计」的思路,不只适用于医疗,在科研、法律等任何需要高准确性的专业领域都有重要价值。

08

外骨骼隐喻:当 AI 让大脑「萎缩」

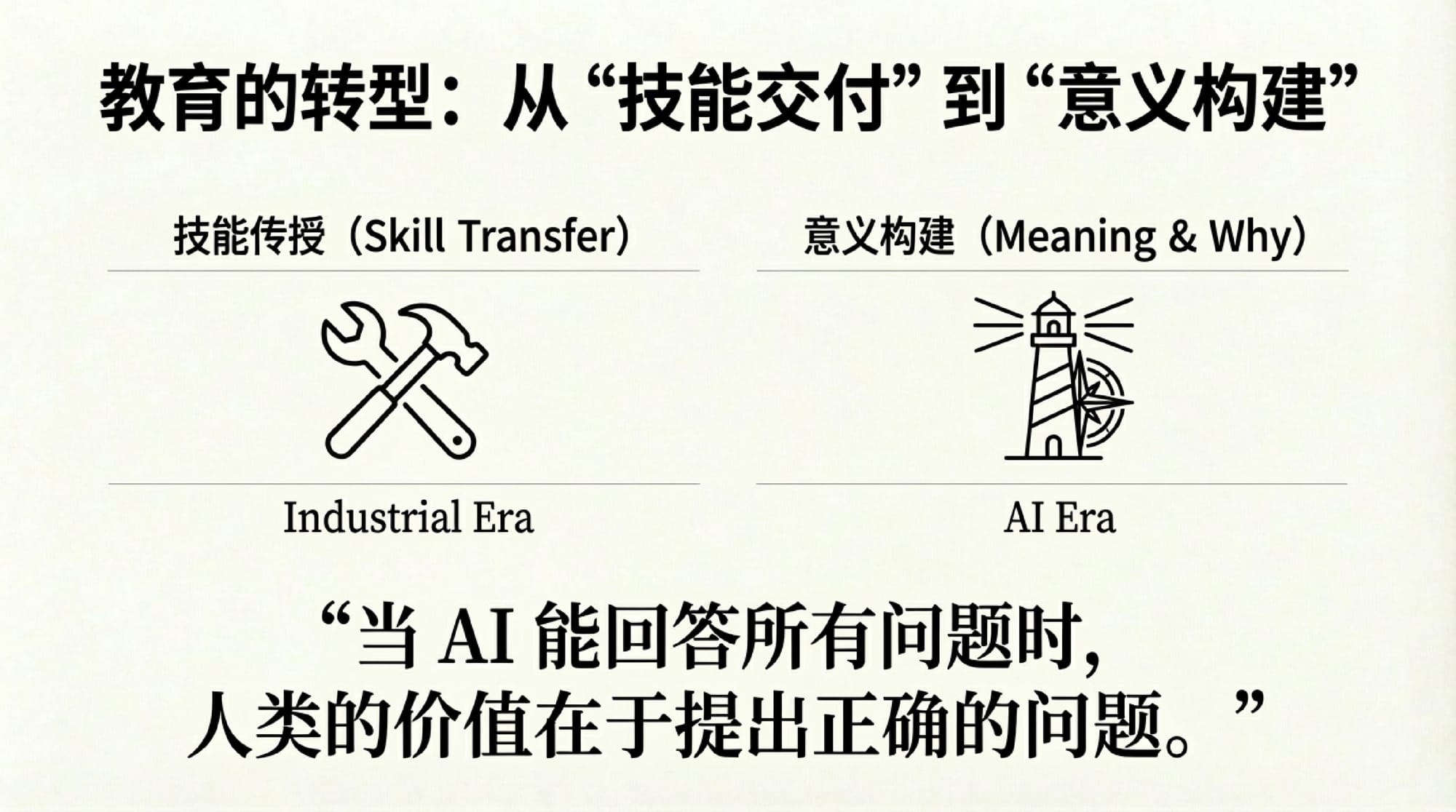

过度依赖 AI 会导致人类认知能力的退化,就像长期穿戴外骨骼会让肌肉萎缩一样。教育的根本使命需要从「教技能」转向「教意义和目标感」。

Anthropic 最近发布了一份研究报告,显示长期使用 Claude Code 的开发者,编程能力都出现了不同程度的退化。霄霄教授对此深以为然,认为这是一个非常严重的问题——过度依赖 AI 会让大脑产生惰性。

Indigo 用了一个特别精彩的比喻:外骨骼。想象你想锻炼肌肉去举重,但现在有了高科技外骨骼,穿上它举重轻轻松松。问题是,你完成了举重动作,却没有锻炼到一块肌肉。长此以往,你的肌肉一定会萎缩。他还拿自己举例:用了 Tesla 的 FSD 自动驾驶之后,他发现自己开车技术明显退步了,所以每周七天中有一天坚持自己开车——就是为了保持基本的驾驶能力。

这个外骨骼隐喻延伸到了教育问题上。Indigo 提出了一个尖锐的追问:当 AI 可以帮你完成几乎所有技能型工作时,你坐在电脑前面,面对 AI,却不知道该问什么——这是因为你没有目标。

教育的历史揭示了问题的根源。从200多年前的工业化时代开始,教育的核心一直是「教技能」——训练士兵听口令、走正步,训练工人操作机器,训练白领使用软件。目标很明确:学会一项技能,然后去工作。但当 AI 可以即拿即用地提供这些 Skill 时,传统的技能教育就失去了意义。

霄霄教授和 Indigo 一致认为,未来教育需要一个根本性的转向:从「教技能」转向「教意义」。过去的教育从来没有教你怎么去寻找意义、制定自己的目标。当越来越多的「牛马工作」被 AI 取代,当能给你下目标的老板也不再需要你的时候,你必须能够自己形成目标。

大学教育仍然有意义,但它的价值不再是传授知识(AI 早就能做到了),而是锻炼两种核心思维能力:Critical Thinking(对问题和答案的审视能力)和逻辑思考能力。那些我们曾经认为「无用」的专业——哲学、理论物理、艺术——在 AI 时代可能反而变得更加重要,因为它们培养的恰恰是通识性的认知框架和跨领域的创造力。

09

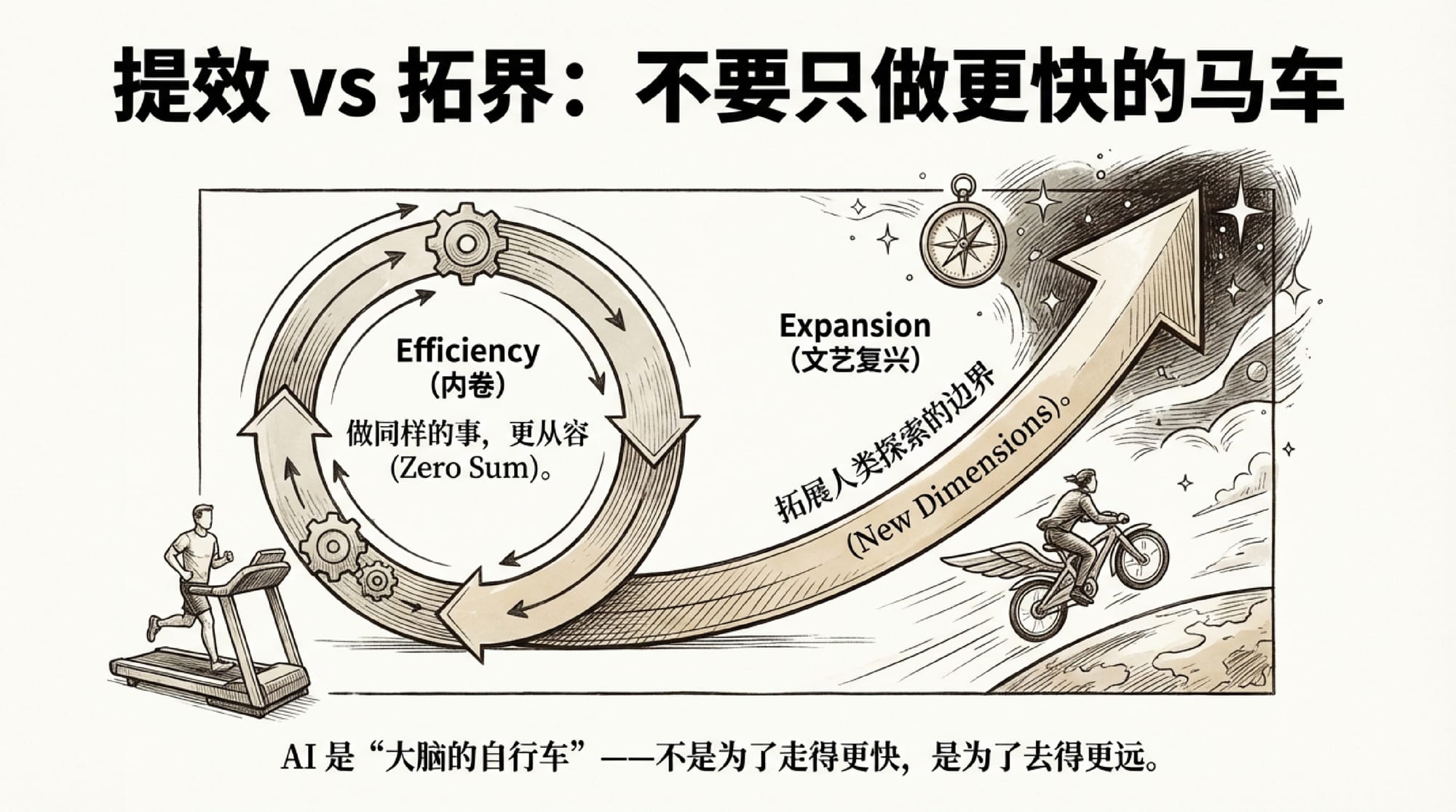

提效 vs 拓界:AI 革命的两个维度

AI 目前主要在提升人类的效率,但它更深远的意义可能在于拓展人类的边界。只有拓展了边界,经济的「饼」才能做大,而不只是内卷。

霄霄教授在接近尾声时提出了一个让人眼前一亮的框架:AI 的发展有两个方向——提升效率和拓展边界。

提升效率是显而易见的:AI 能更快、更好地完成人类本来就会做的事情。但这条路有个问题——如果经济的总量(饼)没有变大,效率高的只是把效率低的吃掉了,最终是一场零和游戏。

拓展边界才是让饼变大的关键。霄霄教授用飞机来类比:飞机不是让马车跑得更快,而是让人类能够飞上天——这是一种全新的维度拓展。历史上每一次让人类在空间中移动效率质变的发明(蒸汽机、铁路、飞机),都带来了全新的产业和职业。而 AI 这一轮革命,就像乔布斯当年说电脑是「大脑的自行车」一样——AI 是真正的智力加速器,它可能让人类的认知和创造力进入一个全新的维度。

Indigo 把这个逻辑延伸得更远:如果 AI 解放了大量的重复性劳动,人们有更多时间投入到创作和探索中,我们可能会迎来一个新的文艺复兴时代。当然,这中间有一段很现实的过渡期——人必须先满足温饱,才能追寻意义。

10

90-90 法则的警醒

软件工程中的 90-90 法则同样适用于 AI 发展——90% 的功能花了 90% 的时间完成,但剩下 10% 的功能也需要 90% 的时间,当前对 AI 进展的乐观情绪可能过于超前。

在对话的最后,霄霄教授贡献了一个非常清醒的收尾。他引用了软件工程中著名的 90-90 法则(Ninety-Ninety Rule):90%的代码花了90%的时间完成,但剩下10%的代码也需要花90%的时间。这意味着,我们可能只完成了 AI 发展中比较「容易」的部分,剩下那最后的10%甚至0.1%,难度可能远超想象。

他用自动驾驶的发展历程来佐证这个观点——几年前大家都觉得全自动驾驶马上就要实现了,但从 L2 到 L5 的跨越远比预想中困难。AI 的其他领域很可能也遵循同样的规律。

这个清醒的提醒为整场充满兴奋和想象力的对话画上了一个恰到好处的句号。未来又好又不好——这种模糊的状态,恰恰就是客观的现实。

当 Indigo 兴奋地描述 AI 的调度能力时,霄霄教授会用 Swarm Learning 来提醒我们:不必假设 AI 的组织方式一定要模仿人类。当霄霄教授用认知心理学的框架分析 AI 的局限时,Indigo 又会指出硅基智能可以通过暴力堆叠算力来突破很多人类面临的物理限制。

更深层次的思考在于:如果 AI 真的可以拓展人类的边界而不仅仅是提升效率,那这场革命的意义就远远超过了我们目前关注的那些「谁会失业」「哪个模型更好」的短期问题。教育需要教的不再是技能,而是目标感和意义感——这个观点听起来理想主义,但在 AI 正以指数速度进化的当下,它可能是最务实的建议。

精华收获

关于 Agent 的本质: Agent 不等于 Chatbot,也不等于 Workflow。真正的 Agent 需要具备自主规划(Planning)、执行、自我反省和纠错的能力。这个定义从1995年到现在没有本质改变。

关于认知局限: 人类大脑的工作记忆容量有限,当任务超过这个容量就会崩溃(Hick's Law)。AI 也有类似的饱和点——单个 Agent 在20-30个 Skill 时性能最优,之后就会饱和。

关于单 Agent vs 多 Agent: 在串行任务中,单 Agent 加技能往往比多 Agent 协作更高效,因为沟通成本和错误累积是多 Agent 的两大瓶颈。但在需要角色分离和并行处理的复杂任务中,多 Agent 架构不可替代。

关于 AI 的组织形态: 不必让 AI 照搬人类的层级管理模式。Swarm Intelligence 这样的去中心化协作可能更适合 AI 的本质——甚至可以反过来启发人类组织的变革。

关于认知萎缩: 过度依赖 AI 会让认知能力退化,就像外骨骼会让肌肉萎缩。保持自主思考的能力需要刻意练习,就像体力劳动自动化之后人们需要去健身房锻炼一样。

关于教育转型: 传统教育的核心是「教技能」,而 AI 时代的教育需要转向「教意义和目标感」。Critical Thinking、逻辑思考、跨领域的创造力——这些将成为人类最不可替代的能力。

关于保持清醒: 90-90 法则提醒我们,AI 发展中最后的10%可能比前面的90%更难。自动驾驶的历程就是最好的前车之鉴。