INDIGO TALK / 知道"什么是好的",比能写出好的更难 - EP47

如果说 2024 年底大家还在围着 o1 和"推理式计算"打转,那么仅仅一年零四个月之后,整个软件工业的 narrative 已经变成了 Agent Harnessing、Skills、面向 Agent 编程,以及"我们到底还需不需要程序员"。

这一期 Indigo 请到的嘉宾是 Sonya——本科经济学、第一份工作做投行、转码进 Meta 做搜索推荐、办过 AI 峰会、现在在做 AI Pharmaceutical 的项目。她是少数同时穿越过"投行—工程—AI 应用—生物医药"的女性技术人,所以这场对谈既能落到代码哲学的细节,又能拉远到组织、社会、人类意义这一层。

两人聊了五十多分钟,从 Vibe Coding 一直聊到星辰大海,但中间有一条非常清晰的主线:当编码这个动作本身被 AI 接管之后,人类剩下的位置在哪里? 答案不像很多硅谷推文里说的那样简单——既不是"被替代",也不是"被解放",而是被推上了一个更高、也更陌生的抽象台阶——成为治理者。

Apple Podcast & Spotify 播客 | 小宇宙播客

时间戳

- 11:07 Agent Harnessing:程序员变成"哲学家"

- 18:59 "知道什么是好的"比"能写出好的"更难

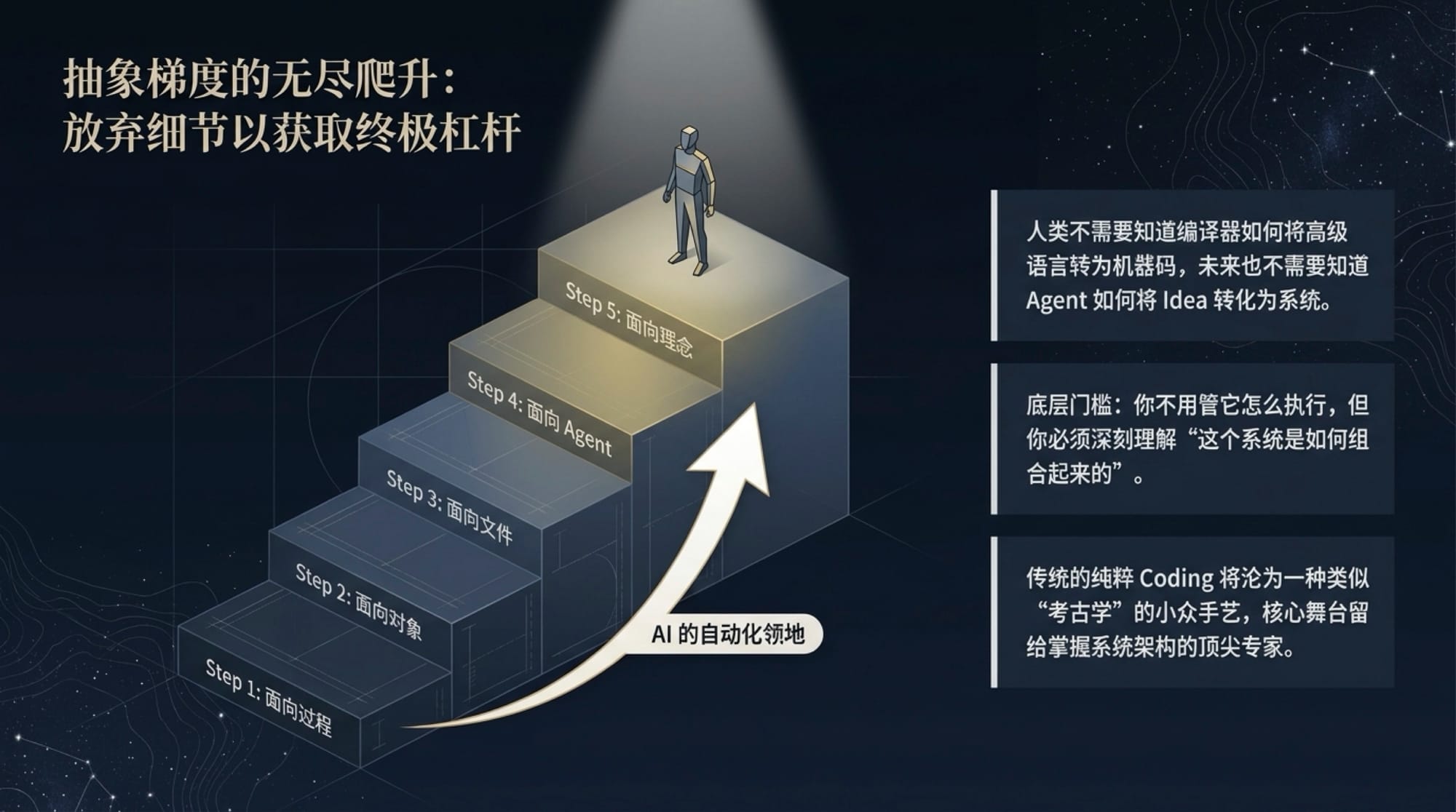

- 22:56 抽象层次的爬升:从面向文件到面向 Agent,再到面向 Idea

- 28:30 SaaS 之死:当软件可以"用完即抛"

- 34:49 Unix 哲学的回归:Everything is File

- 39:46 为什么 10 倍的效率没有带来 10 倍的产出?

- 44:09 思考的技能不能 Degrade:人类专家会更稀缺

- 49:53 从程序员到治理者:Builder 的新身份

- 54:26 最后一个判断:中产坍塌与星辰大海

下面是这一期的完整整理,配合时间戳,可以当作一份"AI 时代职业转型的判断地图"来读。

01

"天变了":从一年前到今天的 16 倍

Sonya和 Indigo 上一次录节目是 2024 年 12 月,从那时到今天,AI 编程能力大概是"每个季度翻倍"——一年下来就是 2 的 4 次方,16 倍的纯能力跃升。

Indigo 一开口就让 Sonya 说说她从 Meta 工程师视角看到的变化,Sonya 的第一句回应是:"我真的觉得,天变了。"[09:09]

她用了一个很重的比喻:一年前那种一行行写代码的年代,现在回头看就像石器时代。[09:34] 她自己已经开始 Vibe Coding——讲一段话,让模型生成整个项目。当然不是每一行代码都能比拼得过人类顶尖程序员的优雅、精简、安全,但对于绝大多数实际的 Coding 工作,甚至对最顶尖的程序员,整体效率是被显著拉高的。

Indigo 在这里抛了一个数字感:从 2024 年底大家还在聊 o1 那种"推理式计算",到现在智能体已经能持续工作四五个小时,模型能力基本上每个季度翻倍。一年下来——2 的 4 次方,16 倍。这已经不是线性,是指数。

而且更可怕的是,这种加速本身正在自我加速:现在的 AI 已经在帮自己写代码、自己迭代版本。Indigo 顺着这个引到 Anthropic 这家公司的形态——为什么 Anthropic 发版本这么快?因为它整个公司是非常扁平的,全员都在用 AI Coding 软件,所有人都在为"让 AI 加速进化"这件事服务。Anthropic 是一种新形态的组织。

这就构成了整场对话的第一个底层事实:编码这件事的产能边界已经移位了。剩下的一个小时,他们都在解一道题——既然产能已经不在写代码这一步上了,那它在哪一步上?

02

Agent Harnessing:程序员变成"哲学家"

现在程序员的关键工作不再是 Line by Line 写代码,而是给 AI 设计一个 Harness(驾驭框架),让模型自己去自我进化、自我净化。这件事更像哲学家做的工作——你设计一个理念,让 Code 在这个理念下自己长出来。

Sonya 提到一个最近被频繁讨论的词——Harnessing,"驾驭"。OpenAI 写过一篇 Agent Harness 的文章,Anthropic 也越来越多用这个词。它的意思是:单纯一个 LLM 就像一颗赤裸的 CPU,本身没有上下文、没有记忆、没有外设。要让它干活,你必须给它一整套"约束 + 工具 + 上下文 + 文件系统 + 网络 + IO + 规则"——这一整套加起来,组成一个让模型能持续运行的运行时框架。

她提了 Andrej Karpathy 那张著名的"LLM 像 CPU"的图,并且补充道:当时画那张图的时候 Harness 这个概念还没出来,现在套上 Harness 的概念,整张图就清晰了——LLM = CPU,Harness = 一台围绕 CPU 设计的计算机。

这一层一旦看清,程序员的工作就变了:

"更像是一个哲学家,去设计一个理念,然后让 Code 在遵守这个理念的情况下,去自我净化。" [12:06]

Indigo 在这里把这个比喻往前推了一步——人类变成了在造每一个 Code Product 的"造神者"。[12:19] 你不再决定它的每一行实现,但你决定它"应该是什么样的存在"。

这件事的难度并不比写代码低,反而更高。因为你不是在解一个有标准答案的小题,而是在为一个会自己生长的系统设定它的"宪法"。比如说,你设计一个推荐平台,那它的 Philosophy 是什么?什么样的推荐机制是有益的,什么是有害的?你不再去手动 hardcode 一堆算法,而是要设计一套理念,让 Agent 自己去生成这些算法——但这些算法又必须始终符合你最初的理念。

Sonya总结说:未来的工程师有两层身份——一方面是系统设计师(数据怎么流、算法平台怎么交互、安全漏洞怎么处理),另一方面更重要的,是理念设计师。

这就引出了下一个、也是这一期最锋利的一个问题。

03

"知道什么是好的"比"能写出好的"更难

理念定义的核心是判断"什么是好的"。但要真正知道什么是好的,你必须曾经亲手一步步做过——否则你的 Reasoning 是漂浮的,没有根基。这是 AI 时代人类最容易丢掉、也最致命的一种能力。

Indigo 在这里讲了 Rick Rubin 那段最近很火的录音——"我不会写代码,但我知道什么是好代码"。[18:57]

听起来很玄。但 Sonya 立刻接住了:

"我觉得 Indigo 点到了一个非常重要的点。以后我们人类知道什么是好的,比能不能自己 Exactly 写出好的,会更重要。 但是大家不要小看这件事——你要去学'什么是好的',其实是非常难的。" [19:06]

她抛出一个反向问题:如果你不会写,你怎么知道什么是好的?

举一个最简单的算法例子:我以"谁最多人点赞"作为推荐目标。短期看似乎没问题,但如果让这种算法长期主导一个平台,那这个平台会被什么样的内容主导?这其实需要你既懂算法、又懂内容生态、又懂人性的累积反应。一个没有任何亲手做过算法的人,没有跌过坑、没有看过这种 Metric 在三年时间维度上扭曲一个产品的过程,他凭什么去判断这是不是一个好算法?

更危险的是 Hallucination。在自己的领域里,你还有直觉能感觉到"AI 这句话好像不对";但只要换到陌生领域——比如药物剂量、医疗诊断、法律——你完全没有能力判断 AI 说的是不是对的。AI 让你吃 100 毫升某种东西,你不知道这对一般人是安全的、对某种人群却是极度危险的。

Indigo 在这里把"直觉"这个东西拆开了:直觉本质上是一个非常复杂的内在模型,是你一步步亲手做过、犯过错、修正过、复盘过之后,沉淀下来的东西。

"你犯过错误,然后你修正过。" [22:42]

Sonya 顺着这个思路讲了一段非常重要的话:

"其实我觉得会是人类一个非常困难的事情。就是如果持续地、在每个领域都保持顶尖的专家,会变成非常重要的东西。 否则我们所有东西都待会给 AI 来评判——这真的安全吗?" [21:59]

这是整场对话第一次出现"危险"这个词。它不是关于 AI 失控的危险,而是关于人类自己丢掉判断力的危险。

这里和 Indigo 后面提到的另一段话呼应得很紧——他朋友的那句话:

"开车技能可以 Degrade,但思考的技能是不能 Degrade 的。" [44:14]

自动驾驶用多了,开车技能退化是可逆的、可补的;但思考能力一旦退化,你连"AI 说的对不对"都判断不了,这是一种单向坍缩,没有回头路。

04

抽象层次的爬升

从面向文件到面向 Agent,再到面向 Idea

编程的抽象层次正在不断爬升。我们经历过面向过程、面向对象、面向文件,今天进入面向 Agent,未来会到面向 Idea。每一次爬升,都意味着我们放弃下一层的细节,但获得更大的杠杆——只要你还知道"系统是怎么组合起来的"。

为了缓和"判断力危机"这个有点沉重的话题,Indigo 主动给出了一个更乐观的视角——这一切其实是抽象层次的自然演化。

我们今天不需要知道编译器怎么把高级语言变成机器码、机器码怎么在 CPU 上执行,但是还是有人知道。我们只是从"必须知道"变成了"在更高层操作"。[22:33]

他给了一条非常清晰的演化曲线:

未来你给系统的不是一份 .py 文件、一份 .cpp 文件,而是一个目标、一个 Agent、甚至直接一个 Idea。[26:00] AI 已经聪明到只要你"提示它一个 Idea",它就能帮你实现。

但这里 Indigo 留下了一个关键的认识论 bound:

"下面我就不用管它怎么执行了,但是——我得知道这个系统是怎么组合起来的。" [23:33]

这就是新一代"程序员"——或者更准确说,新一代 Builder——的最低门槛。你可以不写每一行代码,但你必须理解系统的组合方式、各模块的边界、它们之间如何彼此影响。否则你只是在外包给一个比你聪明的黑箱,而黑箱产生的灾难你既看不出来,也修不了。

Sonya在这里给了一个特别有画面感的猜想:

"可能就像以前我们大部分人都是农民——不是因为农业很高级,而是种粮食必须这么多人。但现在,可能只需要少数人掌握这个技术,再压缩到每个领域只需要更少的人去掌握核心。但这些人会需要是顶尖的 Experts。" [24:09]

她接着补了一个很妙的隐喻——剩下的那一小部分对 Coding 还有执着热情的人,会变成像今天的考古学家一样,专门去研究"代码到底是怎么写出来的"这件事,作为一种 hobby、一种 craft,但不再是社会主流职业。[27:48]

04

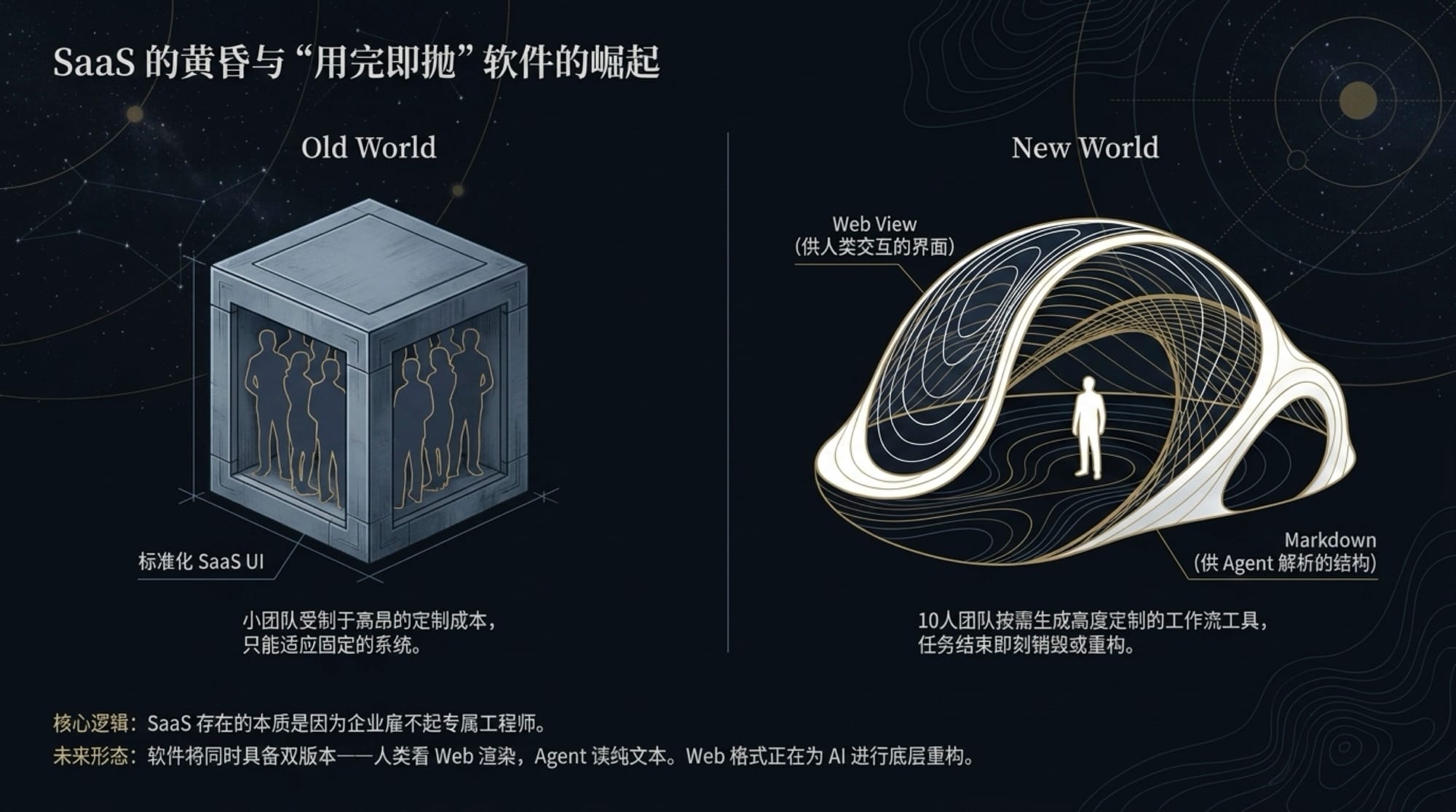

SaaS 之死:当软件可以"用完即抛"

这一代 SaaS 之所以存在,是因为大多数公司请不起 10 个工程师为自己定制软件。但现在,任何一个 10-20 人的小团队,都可以让 Agent 按需为它现写一份软件,用完甚至可以扔掉。SaaS 公司的存活空间正在被压缩到非常窄的一个区间。

Indigo 把节奏带到了一个商业层面的判断:

"这个时代的软件都是标准化的——SaaS 也是标准化的。那是因为很多人没法请很好的团队去定制化我的需求。但是接下来会有一个变化:任何一个小团队,都可以让 Agent 按照我的需求去产生软件。" [28:51]

这个观察对今天的 SaaS 投资是降维打击。一个 10 个人的小公司过去只能用 SaaS,因为它请不起独立的工程团队;但现在,它可以让 Agent 临时生成一份完全为它的工作流定制的软件,用完即抛,或者持续迭代——完全定制化你想要的,不再 stick to 你那固定的 SaaS 页面。

Sonya在这里加了一个非常关键的子话题:面向 Agent 而不是面向人类的开发。

她举的例子是:以后网页可能会有双版本,一个 Markdown 版本(给 Agent 看),一个 Web View 版本(给人类看)。原因很简单——人类看 HTML 渲染那种"用户界面"是高效率的,但 Agent 不需要图片、按钮、动画,它需要的是结构化、可解析的文本。Web 的格式正在为 AI 而重构。

紧接着 Indigo 分享了他自己的实践——他用 AI 做股票投资,搭了 4 个 Agent,每个 Agent 一个角色:

• 一个 Agent 负责观察 Marketing 情绪、宏观新闻;

• 一个 Agent 专门评估每只股票的买入和卖出点;

• 一个 Agent 负责抓取所有公司新闻;

• 一个 Agent 负责仓位平衡。

但他没有把它们拼成一段固定的程序——相反,他让每个 Agent 把执行结果写成 Markdown 文件,其他 Agent 去读这些 Markdown 来获得上下文。甚至还专门拉了一个 "Critic Agent" 来 Criticize 当前 Agent 的判断。最后再叫一个 Agent 把所有 Markdown 渲染成网页给"老板"(也就是他自己)看。

这就是"以文件为中介的多 Agent 协作"——一种轻量、透明、可审计的 Swarm 架构。Indigo 自己评价:

"我肯定没找到更好的 Agent 通讯方法,但是让他们用文本通讯,就很好了。"

由此引出一个值得记下来的隐喻:未来每个人都是一个资本家——只不过他调动的不是人力,而是 Agent。Indigo 早上和朋友聊到的判断:"未来人类只剩两种:人均创始人 / 人均 Boss,以及人均资本家。剩下的人,他们的工作是 投票、投钱、投 Attention。"

06

Unix 哲学的回归:Everything is File

今天的 Agent OS 本质上是 Unix 哲学的升级版——所有东西都是文件、所有协议优先文本、所有交互都是读写。Skills、Memory、Context、Personality——全部都可以沉淀成 Markdown 文件,被组合、被复用、被传承。

Indigo 在这里给了一个非常 Indigo 式的判断:

"我建议现在所有人用 Agent 的、想做 Agent Harness 的人,重新回顾一下 Unix 哲学。"

Unix 哲学三件事:

1. Everything is File —— 所有东西都是文件。

2. 能用文本就不用二进制 —— 所有协议、存储、交互优先文本格式。

3. 确定性优先 —— 能用代码解决的,就用代码解决,不让 AI 重复生成。

这三条今天看回去,简直是为 Agent OS 量身定做的。

为什么 Claude Code 这么流行?因为它给你创造了一个 Workspace,里面有 Memory、有 Soul、有 Skills——全部都是基于文件的。[35:31] Agent 进到这个目录里一看,几秒钟就读懂了:你是谁、你想要什么风格、你处理过什么任务、你的 SOP 是什么。

Sonya补充了一个很新的角度:Unstructured Data 在 LLM 时代不再是"难处理的",反而成了"最丰富的"。[36:12] AI 可以从你过往处理过的所有文件里,反向 Extract 出你的风格、你的常规 SOP、甚至你的 Rare Case 处理方式。

Cursor 最早做了 Rules 文件这种概念,Claude 学过去做了 Claude.md。两人在这里给出一个判断——

"思维目录就是一个电脑上的 Folder,就好像是一个 APP 一样。Agent 加上 Folder,它就能够干活了。"

这就是为什么 Skills 概念最近这么火——它把"你的某项能力"整理成一个可被组合、被搜索、被调用的 Markdown 包,下次类似任务来了,AI 不用从头思考,直接调对应的 Skills。

由此 Sonya 抛出了一个非常意味深长的判断:公司在收集你的"风格"。

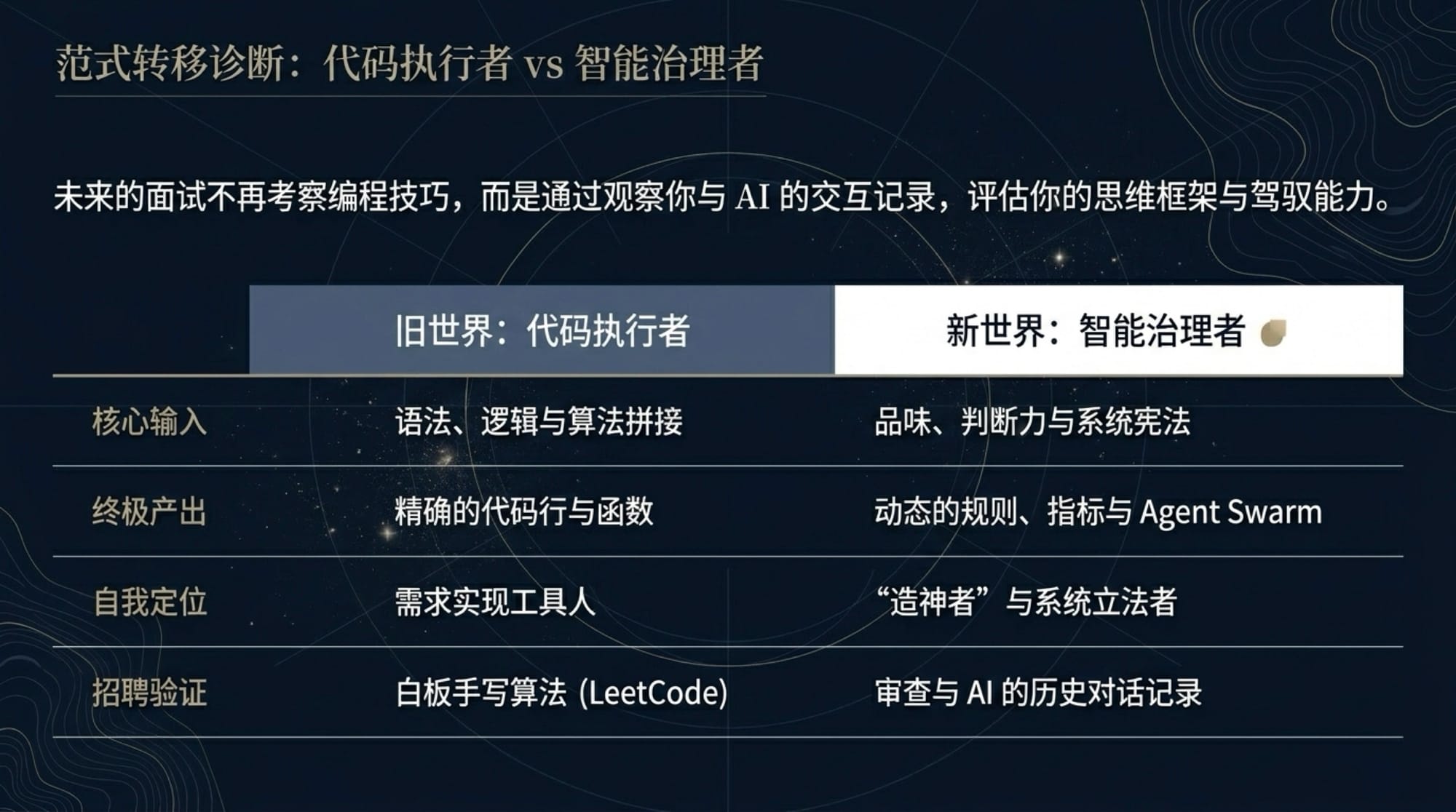

"公司在看你怎么跟 AI Interact,然后去学习你、复制你。可能你处理同一个 Case 比我特别优——那就让 AI 学习你的方法。" [38:00]

Indigo 接住这个观察立刻类比到招聘:

"我觉得接下来招工程师应该这样招了——你不用考他这些编程技巧、代码,你考他怎么和 AI 聊天的。把他和 AI 的对话记录给我看一眼,我就知道你是什么风格的人。" [38:14]

这是 Coding Interview 的下一个版本——从"看你能不能写算法"到"看你能不能驾驭 Agent"。

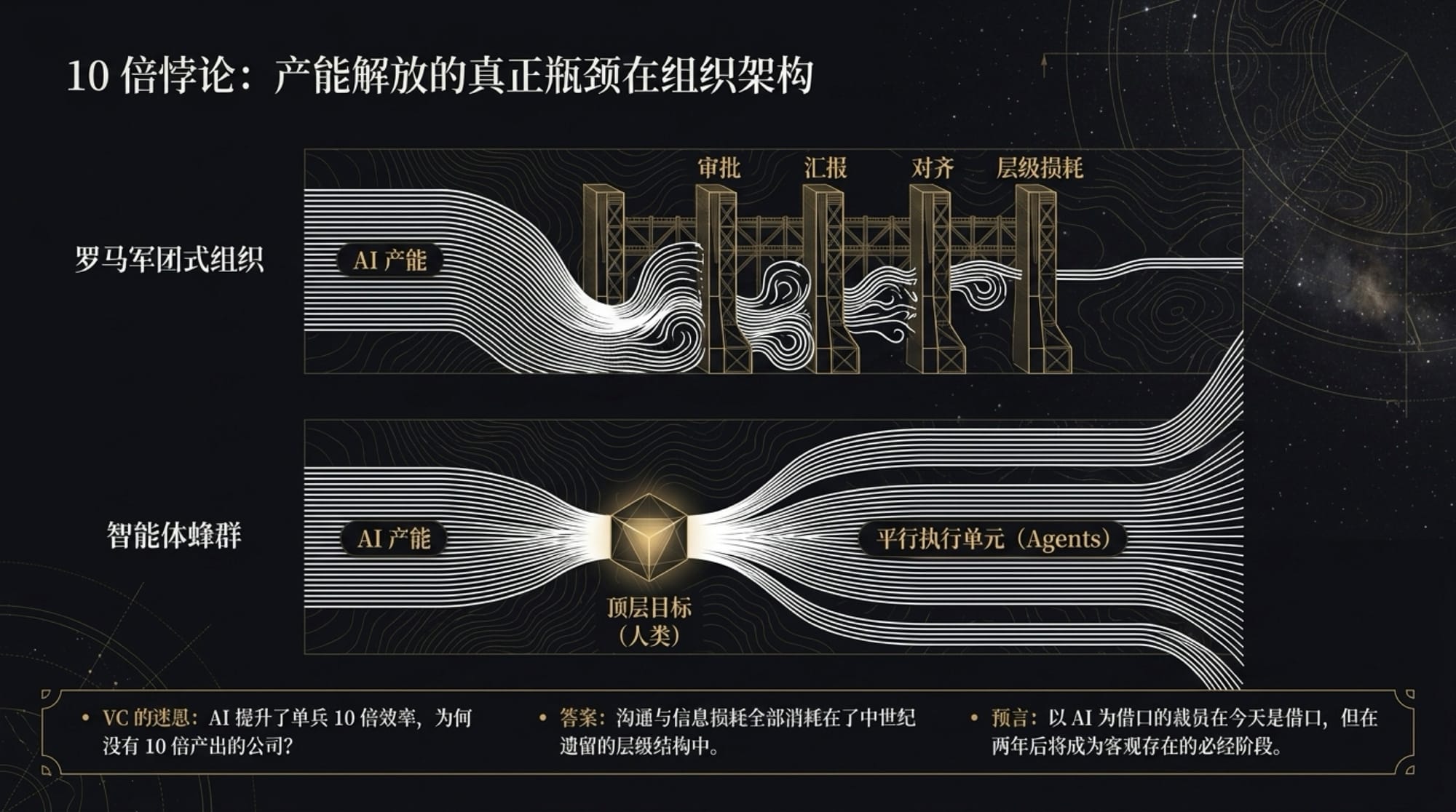

07

为什么 10 倍的效率没有带来 10 倍的产出?

现在 VC 圈最热的一个问题是——AI 把单兵效率提了 10 倍,为什么我们没看到 10 倍产出的公司?答案是:组织结构不是 10 倍的。沟通损耗、审批层级、罗马军团式的指挥链——这些都把 AI 的效率消化掉了。Anthropic 这种扁平化、Agent Swarm 化的组织,才是 10 倍产出的真正解。

Indigo 在这里直接抛出 VC 圈的迷思:

"为什么 10 倍的效率,目前我们还没有看到 10 倍的产出?" [39:40]

Sonya的回答是: 因为组织不是 10 倍的。沟通都损耗在组织的结构里面去了。

她展开了:现代公司的组织结构其实从罗马军团传下来——一级二级三级一直往下传,每一层指令传递都会损耗,下一层的人还要 Prove 自己存在的价值。指挥层带宽天然不够,没法直接指挥前线的每一个执行单元。

但是 Agent 不一样——Agent 可以直接穿透指挥到前面的每一个执行单元。[41:50] 它就是一个 Swarm。Claude Code 默认能并行启动 6 个、10 个、甚至 100 个子 Agent,唯一限制是 Token 消耗速度,也就是钱够不够,不再是模型能力或人力的问题。

这意味着公司形态会变:原来 5-6 层的指挥链,未来可能压缩成 2 层。老板有一个最大目标,下面直接是 Agents,Agents 自己分配子 Agents——所有的"数字端"工作(代码、设计、文档)全部由 AI 处理。

这里 Indigo 引用了 Marc Andreessen 最近的一句话:现在很多公司号称是用 AI 作为借口去裁员;现在是借口,但过两年就不是借口了。

Sonya顺着这个判断的反面,提出 Amazon 最近的反向操作——亚马逊几次大事故后,要求人类必须审核 AI 生成的代码。但她自己的判断是:

"这只是一个阶段性的问题。要真的靠人脑去审核所有东西,那太慢了,那会变成一个新的 Bottle Neck。" [41:01]

人类在新组织里的角色,被推到了"边缘"——不是贬义的边缘,是物理意义上的边缘:

"AI 再怎么好,他在现实世界中没有 Experience、没有接触。所以人更多的是去做情绪关怀、做沟通、做体验、做接触。 给 AI 跑腿,把现实数据收集回来传给 AI。就相当于我们是小脑——大脑慢慢被 AI 替代了。" [43:31]

这是一个非常具体的画面:未来人类的位置,是 AI 这个"分布式大脑"的小脑和外周神经。

08

思考的技能不能 Degrade:人类专家会更稀缺

当一个人不再亲手经历"一步步做"的过程,他失去的不是某种执行技能,而是判断力本身。未来世界会两极化——少数顶尖 Expert 会变得极其稀缺、极其重要,因为只有他们能跟模型做 Alignment、做审查;剩下的人会被推向情感、关怀、生活的另一极。

Indigo 在这里认真讲了他朋友那句话:

"开车技能可以 Degrade,但思考的技能是不能 Degrade 的。"

但是 Sonya 立刻接住——问题恰恰在于,一个人如果没有一步步去做过这些东西,空泛的 Reasoning 是不扎实的,很容易被 Mislead。

她描绘了未来的两极:

• 一极是顶尖专家:能做 Alignment、能做最后一道审查、能判断"AI 说的对不对"。

• 另一极是大量的人:把 Attention 放在生活和关怀上,承担情绪劳动、现实接触、社交体验的部分。

但她随即指出一个更深的悖论——

"人是不能够被逼迫的。我不能逼你成为一个顶尖的专家。" [14:14]

如果整个社会变得很富裕(每个人的物质需求都被自动化的生产解决了),那它就有点像今天的"人人都是富二代"。富二代会做什么?观察今天的富二代你就知道了——寻找刺激、寻找意义。

这就走到了对话最沉重的地方:

"如果说工作不需要了——大量人,其实生活真的没有意义了。" [26:49]

"好的价值观可能会变得更重要。" [46:04]

Indigo 把这一段拉回到一个更宏观的历史尺度:人类两三百年工业革命下来,意义感都是建立在"劳动和生产"之上。突然这五到十年,工作不需要了,意义体系还来不及重建。打猎种田、农业生产、工业生产、智力劳动——一层层都被替代之后,除非我们的脑子能开发出新的东西,否则就是空窗。

09

从程序员到治理者:Builder 的新身份

未来的"工程师"如果还存在,他做的事情是 Governance——不是 Line by Line 写代码,而是设计一个系统的理念、Metric、推荐机制、平台规则。每个人都会成为他所负责板块的"总督"。Taste 和 Judgment 比 Execute 更重要。

Sonya 把这个判断说得非常具体。她给未来工程师定义了三件事:

1. 设计 Philosophy —— 我们认为"什么是好"。

2. 定义 Metric —— 用什么来衡量"是否真的好"。Metric 一旦设错,整个系统就会扭曲

3. 持续审视 —— 现在设计的系统是否真的 Truly Serve 我们最初的 Purpose。

也就是说,工作的核心 input 不再是代码,而是 Taste(品味)+ Judgment(判断力)。

她顺便给出了 Anthropic 之所以代码模型领先的非工程解释:他训练数据挑得好、目标清晰、不分心。

"Anthropic 不会像 OpenAI 那样跑乱了——东想做生图、西想做视频。它就一心做代码 Agent。" [59:02]

Indigo 给了一个特别精确的比喻——每个人都是总督:

"每个人都是总督——这里有一个小国家给你管理,应该怎么搞。" [50:14]

不同的"国家"会有不同的治理风格:

• 有些平台会很 Extreme,主打博弈、刺激;

• 有些平台主打温暖、Softness、Encouraging;

• 有些主打专业极简——

而工程师/Builder 的任务,是为这个"国家"立法、定 Metric、做治理者。

这个变化对就业市场的影响是双向的:

• 第一阶段(短期):传统程序员数量会减少,因为大量低层次的写码工作被 AI 直接吸收。

• 第二阶段(中期):随着每家小公司、每个个体都能拥有为自己定制的软件,软件需求的总量反而会爆发。这时候市场需要更多 Builder/治理者,但他们的雇佣形态会变——不再是某个大厂的全职员工,而是 Contract、多公司服务、20% 给一家、20% 给另一家。

Sonya 给了一个让 Indigo 印象很深的总结:有一部分人会变得更累、有一部分人会变得更闲。累的是那些被多个 AI 任务追着等审核、等决策的治理者;闲的是不需要承担治理责任的大多数。

10

最后一个判断:中产坍塌与星辰大海

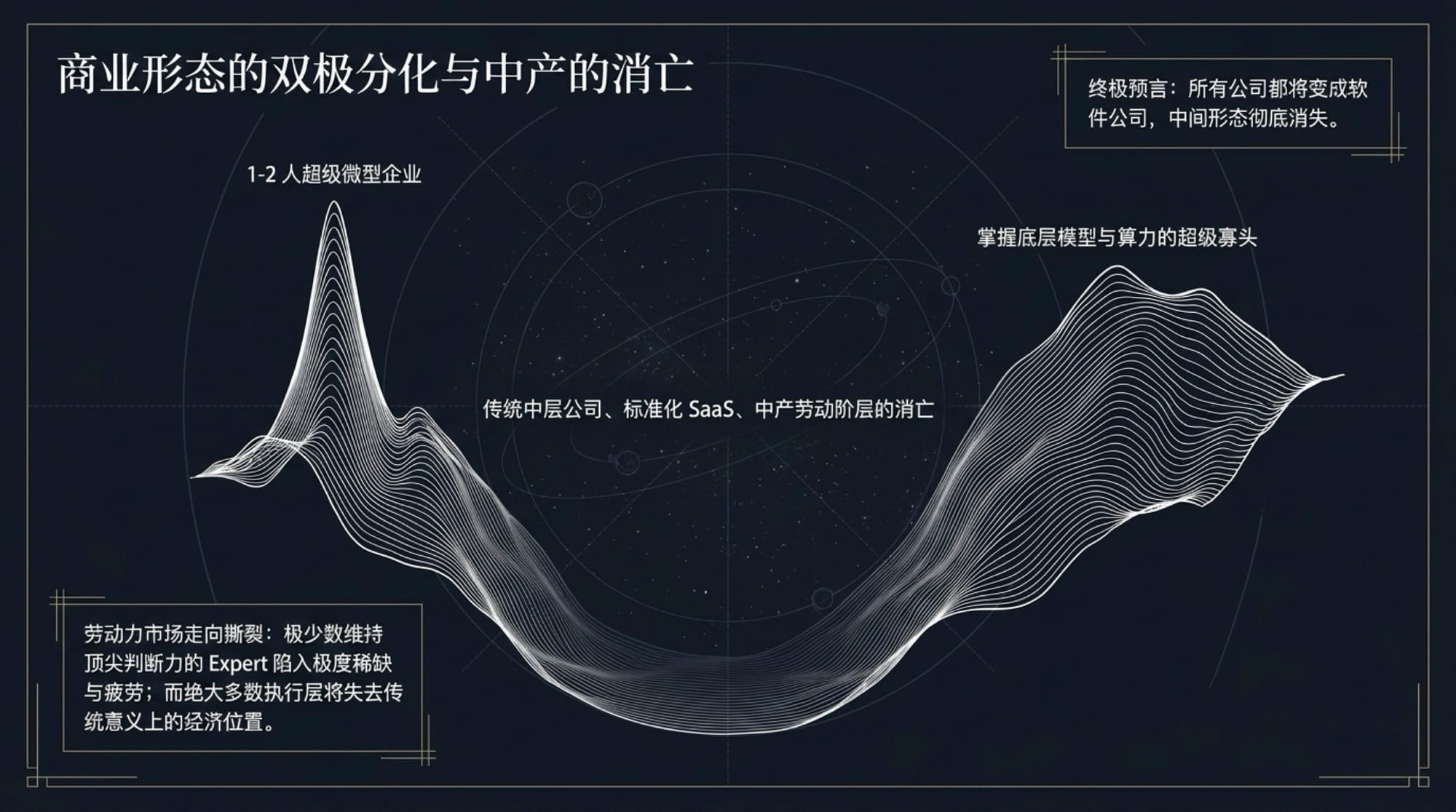

未来的公司形态只剩两端——一两个人的小公司,和巨型公司,中间形态消失。社会层面表现为中产阶级坍塌。唯一能避免社会崩塌的方法,是把生存底线变高(UBI)+ 向外探索新疆界。否则我们会困在地球上、意义空虚、没有下一代。

对话进入收尾,Indigo 给出了一个他自己得出的 punchline:

"任何一个公司都会变成软件公司——任何一个业务都变软件。然后在这个里面,只会存在'一两个人的小公司'和'巨型公司'。中间形态消失。"

Sonya立刻同意,并且把它接到社会层面:这就跟今天的社会一样——中产阶级坍塌。

那怎么办?两人的判断惊人地一致——唯一的方法是把生存底线变高:

"拯救这个社会,唯一的方法就是你把生存底线变高。UBI 啊、什么的实现——大家有一定的收入基础,然后在这上面去实现价值。不然这个社会就坍塌掉。" [54:29]

这是经济侧的解。但 Indigo 觉得这还不够。他给了一个更大尺度的设想——人类的意义危机,最终需要靠"星辰大海"来解决:

"Elon Musk 帮大家解决一个意义危机——你还是往星辰大海去探索,才能解决我们的意义问题。你要发现宇宙才行。不然我们就会困在这个星球上,意义空虚,慢慢没有下一代,然后真的就没有了。"

Sonya 补充说:现在外太空探索能力还远远不够,必须先把它做到让"每人 Assign 一个外太空项目"成为可能的程度。

最后这一段把整场对话从"AI 和编码"拉到了"人类和宇宙"的尺度。它不是为了 dramatic,而是因为前面那条逻辑链——

编码 → 抽象层次升级 → 程序员变治理者 → 公司形态两极化 → 中产坍塌 → 意义危机

—— 走完之后,必须要找一个出口。要么是"提升底线"(经济解),要么是"扩张空间"(物理与意义的解)。两者其实都不是 AI 给的,反而是 AI 留给人类自己的功课。

精华收获

如果让我从这一小时里只挑五句话带走,会是这五句:

1. "知道什么是好的,比能写出好的更重要——但要知道什么是好的,你必须曾经亲手做过。"

2. "开车技能可以 Degrade,但思考的技能是不能 Degrade 的。" —— 抽象层次的爬升不能跳过"亲手做"这一层,否则爬上去是悬空的。

3. "为什么 10 倍效率没有带来 10 倍产出?因为组织不是 10 倍的。" —— Agent Swarm 这种新型组织,是产能解放的真正瓶颈所在。

4. "以后只剩两类人——人均创始人 / 老板,和人均资本家。剩下的人投票、投钱、投 Attention。" —— 这是对未来"分工"的一种刺眼但精确的概括。

5. "任何一个公司都会变成软件公司。中间公司消失。" —— 这是对 SaaS 投资逻辑、对中产阶级未来、对整个组织演化最锋利的一句判断。

第六句留给所有读完的人——好的价值观会变得更重要。这不是装饰性的结尾,而是意味着:当工作不再决定你是谁,你信什么就会比你做什么更重要。

整理:2026-05-08 · 节目原始来源:Indigo Talk EP47 · 嘉宾:Sonya